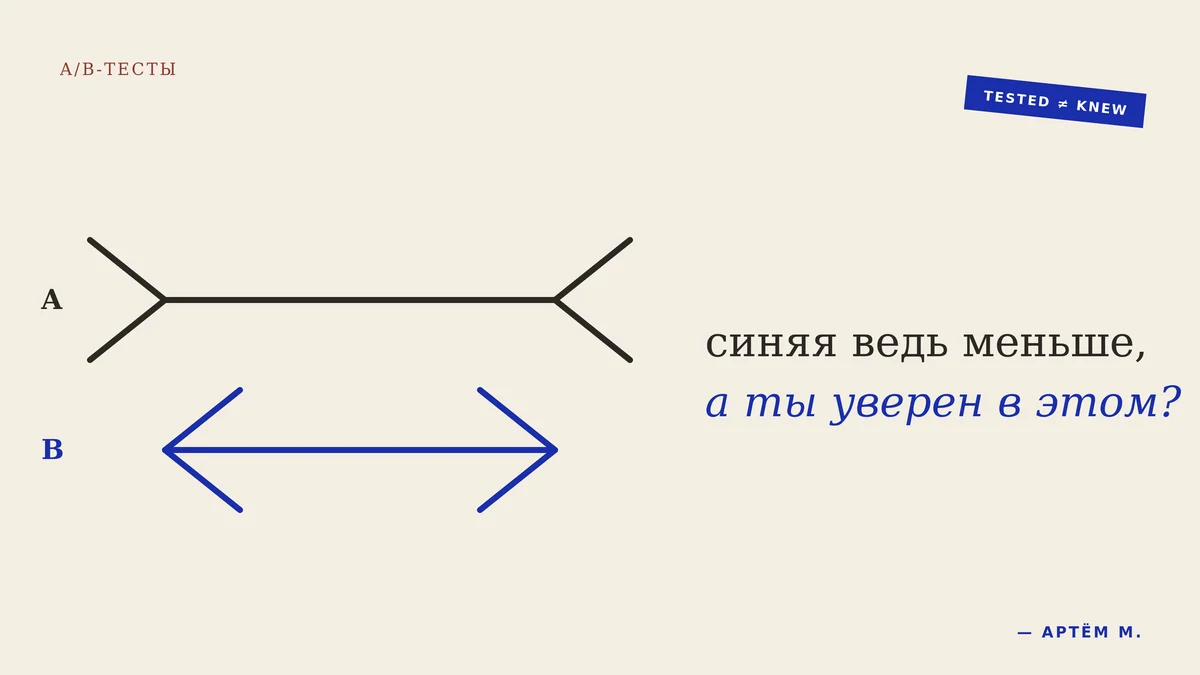

Недавно общаясь с коллегами по рынку, кто только недавно пришел в сферу crm-маркетинга / продуктового-маркетинга, я заметил одну вещь, которая не давала мне покоя. Рассказ шел про тестирования и было много сказано, но одно я понял точно - есть много ошибок в тестированиях не только в статистике, но и в дизайне самих тестов.

Давайте на 3 простых примерах я наглядно покажу что не так и на будущее дам 5 поломок, которые иногда могут скрываться от ваших глаз

Тема письма - самый понятный тест

Допустим, у тебя email-рассылка и ты хочешь поднять open rate. Берёшь сегмент, выделяешь контрольную группу, целевую делишь пополам, отправляешь два варианта темы.

Одна переменная, одна метрика, быстрый результат. Здесь сложно ошибиться с дизайном, потому что всё прозрачно - ты точно знаешь, что тестируешь и по чему меришь. Хороший тест для старта, чтобы набить руку и понять логику.

Оффер на средний чек - уже интереснее

Допустим, интернет-магазин тестирует два оффера:

- Скидка при покупке от определённой суммы, нацелен на поднятие среднего чека

- Скидка без порога, нацелен на конверсию.

Запустили, первый оффер дал средний чек выше. Победа?

Не факт.

Если отследить когорту дальше, можно увидеть что клиенты, которые купили дороже, вернулись позже или не вернулись вообще. Т.е. в моменте выиграли, а на дистанции - потеряли частоту. Поэтому здесь обязателен пост-период по когорте. Без него видно только половину картины, а решение принимается на неполных данных.

Реактивация спящей базы - тут всё сложнее

Есть сегмент, который не покупал 90+ дней. Задача - вернуть. Варианты:

- Скидочный оффер

- Контентная цепочка

- Эмоциональное сообщение в духе "мы соскучились".

Ключевой вопрос, который нужно задать до запуска: а что считается реактивацией? Одна покупка? Две за квартал? Возврат к средней частоте? Потому что скидка может дать быстрый возврат, но без повторной покупки. Контентная цепочка - медленный возврат, но более устойчивый. И если не зафиксировать критерий заранее, после теста начнётся подгонка результатов под удобный вывод.

Это уже не тестирование, это самообман с дашбордом.

Где обычно ломается

Неправильный дизайн теста - сравнивают не то или не так. Вместо того, чтобы в рассылке на реактивацию смотреть на Retention клиентов относительно разных офферов, смотрят на CR в моменте и получается, что прожигают маржу тем, что в перспективе не даст результат.

Один тест - увидели разницу на одном проведенном тесте и побежали масштабировать. Через неделю рассылка не красится, приносит отрицательные результаты, но оффер уже раскатали. Я стараюсь всегда делать несколько тестов, так как большое кол-во факторов, на которые мы не можем повлиять и нужно быть уверенным на 100%, что наше решение работает при любых обстоятельствах.

Метрику выбирают после запуска или неверно выбирают метрику - запустили тест, получили данные, и начинается "а давайте ещё вот по этой метрике посмотрим". Если метрику выбираешь после - ты не гипотезу проверяешь, а ищешь подтверждение.

Неверно понимают силу теста и его приоритетность. Что сильнее в плане теста -другой цвет кнопки или тестирование другого оффера/механики? Тестировать цвета кнопок не бесполезно, но если ресурс на тесты ограничен, начинать с этого странно. Начинай с того, что даст больший результат.

Надеюсь, что этот пост помог кому-нибудь чуть больше разобраться в A/B-тестах и перепроверить себя : )

Комментарии

Войдите или зарегистрируйтесь, чтобы оставить комментарий